- Social media voedt de verspreiding van nepnieuws

- De opkomst van deepfakes

- Een bedreiging voor individuen en bedrijven

- Een aanval op de democratie en de waarheid

- We hebben (nog) geen oplossingen voor dit probleem

- Techbedrijven vechten terug

- Hoe ver is te ver?

We worden de laatste jaren overspoeld met nepnieuws, wat leidt tot een verslechtering van de wereldwijde politieke en sociale problematiek. De Franse staatssecretaris van Digitale Zaken, Mounir Mahjoubi, beschuldigde de protestbeweging de Gele Hesjes onlangs van het verspreiden van desinformatie en nepnieuws en de helft van de Amerikaanse burgers zegt regelmatig nepnieuws te zien op social media. En de invloed van dit fenomeen neemt niet af. Integendeel zelfs. Dat is onder meer te zien aan de opkomst van de steeds moeilijker van echt te onderscheiden deepfakes, gefabriceerde video’s van mensen die dingen zeggen of doen die ze nooit hebben gedaan of gezegd.

Voorbeelden als de zeer realistische nepspeeches van de Amerikaanse president Donald Trump of de gefabriceerde sekstapes met beroemdheden als Gal Gadot zijn het bewijs dat er een gevaarlijke trend in opkomst is. Op kunstmatig intelligentie gebaseerde video- en beeldmanipulatie wordt een nieuw wapen waarmee je kunt chanteren, paniek kunt zaaien en het vertrouwen in de democratie kunt ondermijnen.

Social media voedt de verspreiding van nepnieuws

Facebook is vooralsnog een van de belangrijkste platformen voor het verspreiden van nepnieuws. De top 50 nepberichten van 2018 genereerden maar liefst 22 miljoen interacties, in de vorm van reacties op of het delen van deze berichten.

Nepnieuws met de titel “Michael Jordan resigns from the board at Nike, takes ‘Air Jordans’ with him” genereerde bijvoorbeeld 911.336 interacties. Het bericht werd gepubliceerd kort nadat Nike had aangekondigd dat voormalig National Football League (NFL) quarterback Colin Kaepernick het gezicht zou worden van hun nieuwe marketingcampagne. De activistische Kaepernick was de eerste NFL-speler die weigerde op te staan voor het Amerikaanse volkslied als protest tegen racisme en buitensporig politiegeweld tegen zwarte Amerikanen. Dit leidde tot veel commotie in de VS. Veel Amerikanen zagen deze actie als een belediging voor hen die hun leven voor hun vaderland hebben gegeven. Het was deze commotie die het onechte Nike/Michael Jordan-bericht de wereld in hielp. Jordan was echter nooit lid van de raad van bestuur van Nike en kon er daarom dus ook niet uitstappen.

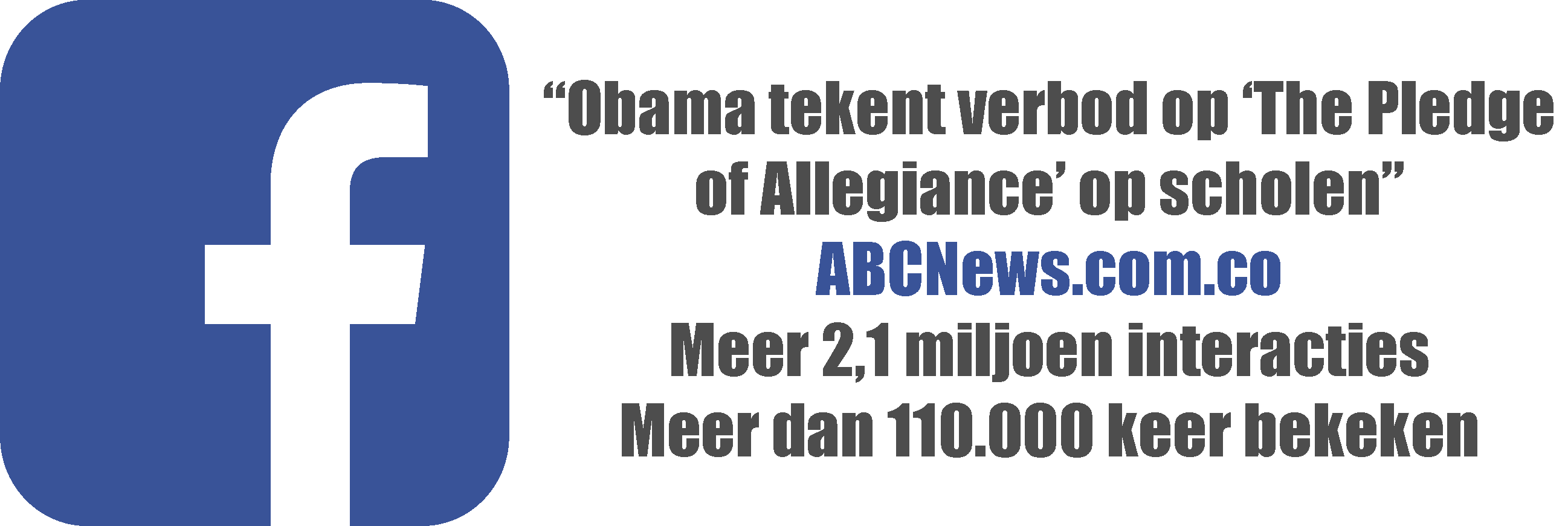

Maar nepnieuws over beroemde sporters heeft natuurlijk lang niet zoveel impact als berichten over bijvoorbeeld hooggeplaatste politici. In 2016 was het best presterende nepnieuws volgens BuzzFeed News het bericht van de voormalige Amerikaanse president Barack Obama. In dit bericht beweerde Obama dat hij The Pledge of Allegiance (trouw zweren aan de vlag) op scholen met een presidentieel decreet had verboden. Dit nepnieuws werd gepubliceerd op ABCNews.com.co, een nepwebsite die sterk lijkt op de echte ABC News website, wat het bericht nog meer geloofwaardigheid gaf. Het werd in twee maanden tijd meer dan 110.000 keer bekeken en genereerde op Facebook meer dan 2,1 miljoen interacties (shares, likes en comments).

Facebook legt uit dat het dit soort nepnieuwspublicaties om verschillende redenen over het hoofd kan zien. Soms kan de social mediagigant nepartikelen er niet uitpikken omdat ze er vaak net zo uitzien als een gewoon nieuwsbericht. Bovendien gaat nepnieuws vaak al viraal voordat fact-checkers daadwerkelijk kunnen bewijzen dat het verhaal is gefabriceerd. Dit imperfecte systeem verklaart waarom social media een ware broedgrond is geworden voor de informatieoorlog.

Door de opkomst van deepfakes wordt de nepcontent-problematiek zo mogelijk nóg serieuzer. Met deze zeer realistisch uitziende content kun je in de toekomst waarschijnlijk zelfs betrouwbare nieuwsbronnen voor de gek houden. Deepfakes hebben vergeleken met ‘gewoon’ nepnieuws potentieel nog veel ernstigere gevolgen.

De opkomst van deepfakes

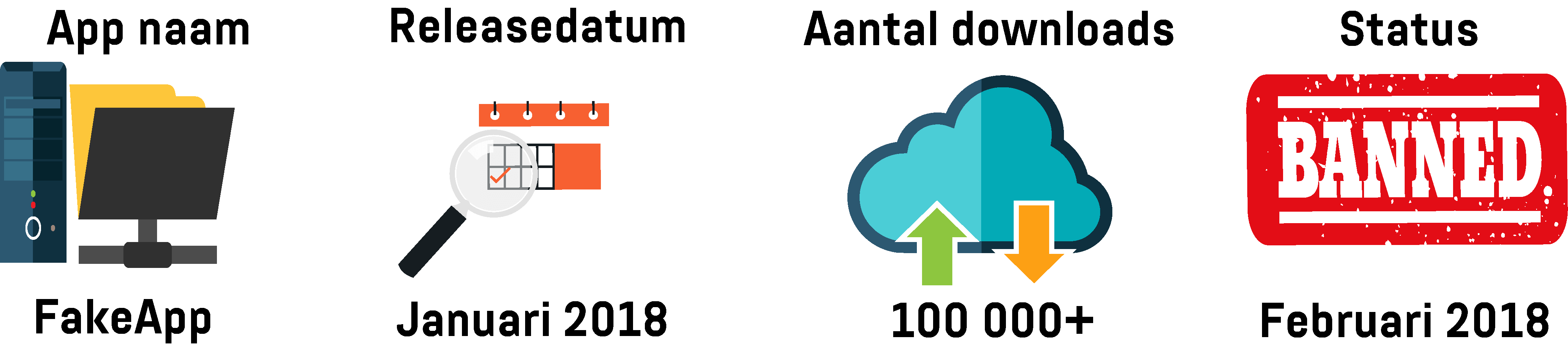

Deepfakes verschenen eind 2017 voor het eerst op Reddit in de vorm van neppornovideo’s van verschillende vrouwelijke beroemdheden. Deze technologie werd in januari 2018 dankzij de FakeApp desktop app beschikbaar gemaakt voor het grote publiek. Met FakeApp kun je realistische video’s maken waarin je de gezichten van mensen kunt verwisselen. De app werd meer dan 100.000 keer gedownload, voordat Reddit hier een maand later een stokje voor stak. Maar deze tool die mogelijk gemaakt wordt door deep learning algoritmes en gezichtsanalysesoftware, had zich al razendsnel over het internet verspreid en steeds meer mensen begonnen nepvideo’s te maken die online gretig gedeeld werden. Onderzoekers van de Universiteit van Warwick hebben geconcludeerd dat nepberichten zich sneller verspreiden dan echte berichten en dat het vaak meer dan 14 uur duurt voordat deze ‘ontmaskerd’ worden.

De FakeApp desktop app voor het creëren van deepfakes werd in januari 2018 op Reddit geïntroduceerd. FakeApp werd meer dan 100.000 keer gedownload en verspreid voordat het een maand later van Reddit verwijderd werd.

Dat video’s die gemaakt zijn met tools als FakeApp en bijvoorbeeld Face2Face (waarmee je in real time deepfakes kunt creëren en iedereen alles kunt laten zeggen) zo snel viraal gaan – met alle potentieel catastrofale gevolgen van dien – is een zorgwekkend gegeven.

En er zijn nog veel meer van dit soort trends in ontwikkeling. Onderzoekers aan de Universiteit van Heidelberg in Duitsland hebben namelijk deepfakes-technologie getest waarmee je niet alleen gezichten maar zelfs volledige lichamen kunt manipuleren. De technologie is voorlopig nog verre van perfect en je kunt duidelijk zien dat de video’s gemanipuleerd zijn. Maar zodra deze techniek volledig ontwikkeld is kun je er – bijvoorbeeld in combinatie met stemimitatie en lipsynchronisatie – echt van alles mee doen. Onderzoekers aan de Universiteit van Alabama in Birmingham in de VS slaagden erin om stemmen zó na te bootsen dat ze er zelfs biometrische authenticatiesystemen mee om de tuin konden leiden. Een macaber kijkje in de toekomst is ook de recente en zeer geavanceerde deepfakes-video waarin het gezicht van actrice Jennifer Lawrence tijdens haar toespraak op de Golden Globes werd verwisseld met dat van acteur en regisseur Steve Buscemi.

Een bedreiging voor individuen en bedrijven

Deepfakes kunnen op allerlei manieren tegen je gebruikt worden. Ze kunnen jarenlang hard werk vernietigen, gezinnen kapot maken en reputaties vernietigen. Rana Ayyub, een onderzoeksjournalist in India, was het slachtoffer van deepfakes-porno die volgens haar bedoeld was om haar samen met hatelijke uitspraken en en karaktermoord in diskrediet te brengen. Ayyub werd online bedreigd, haar privacy werd geschonden en ze moest haar Facebook-account zelfs sluiten om aan de vernederingen te ontkomen. Het was uiteindelijk onder druk van de Verenigde Naties dat de Indiase regering actie ondernam om haar te beschermen.

Ook ‘gewone’ hackers maken maar al te graag gebruik van de viraliteit van deepfakes. Ze kunnen namelijk malware aan videobestanden toevoegen om toegang te krijgen tot een computer en waardevolle informatie als creditcardgegevens of logins voor websites te stelen. Als de computer deel uitmaakt van een bedrijfsnetwerk kan dit de beveiliging van het hele bedrijf in gevaar brengen. Deepfakes worden door hackers voornamelijk gebruikt om personen en bedrijven af te persen. Gefabriceerde video’s van CEO’s die zich bezighouden met compromitterende activiteiten of racistische opmerkingen maken kunnen ervoor zorgen dat de aandelenkoersen van een bedrijf van de een op de andere dag ineenstorten. Michelle Drolet, de oprichter van datasecuritybedrijf Towerwall, stelt dat leidinggevenden die met gebruik van deepfakes worden gechanteerd er uiteindelijk vaak voor kiezen om te betalen in plaats van veel tijd en energie te steken in het proberen te bewijzen dat de video nep is. Criminelen deinzen er niet voor terug om afpersing te gebruiken om te krijgen wat ze willen. Alleen al in Engeland en Wales registreerde de politie in 2017 en 2018 maar liefst 8.333 chantage-overtredingen en deze aantallen blijven groeien.

Een aanval op de democratie en de waarheid

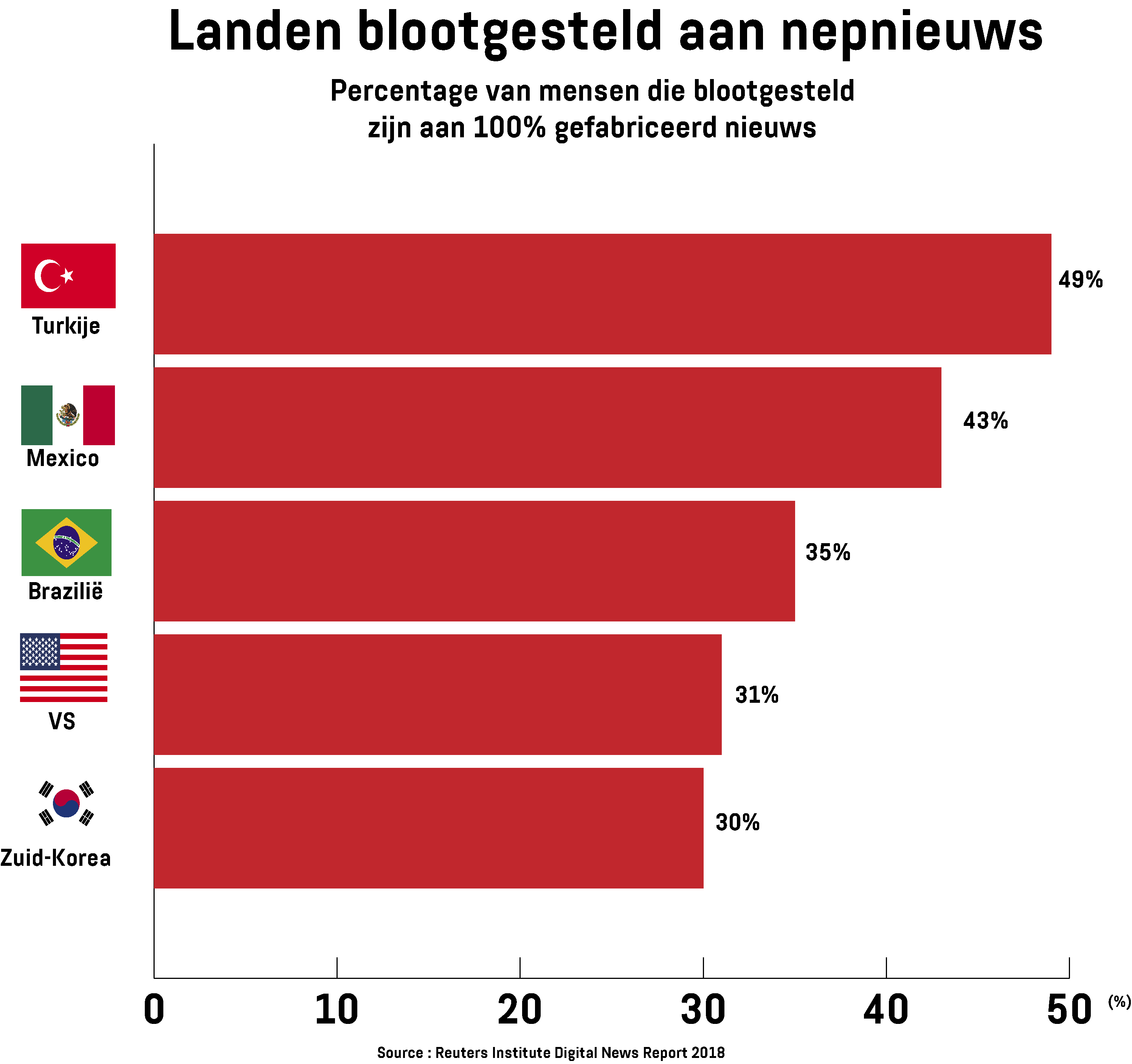

Maar wat eigenlijk nog vele malen angstaanjagender is, is dat deepfakes ook steeds vaker gebruikt worden om politieke en overheidssystemen in democratische landen te ondermijnen. In landen als Turkije en Mexico denkt meer dan 40 procent van de mensen dat ze al zijn blootgesteld aan nepnieuws. In Brazilië, Zuid-Korea en de VS ligt dat rond de 30 procent.

Probeer je de potentiële gevolgen voor te stellen van een video waarin een president aan de vooravond van belangrijke verkiezingen bijvoorbeeld steekpenningen aanneemt of beelden van ambtenaren die een “dreigende raketaanval op Los Angeles of een opkomende pandemie in New York” aankondigen, zeggen juristen Bobby Chesney en Danielle Citron.

Om te laten zien wat we in de toekomst kunnen verwachten heeft acteur en producer Jordan Peele in samenwerking met BuzzFeed een nepvideo gemaakt van de voormalige Amerikaanse president Barack Obama die nogal heftige uitlatingen doet over Donald Trump en de toekomst van deepfakes en nepnieuws.

Een probleem waar we (nog) geen oplossingen voor hebben

Wetgevers in de VS zijn behoorlijk onder de indruk van de gevaren van deze nieuwe technologieën. De Amerikaanse senator Marco Rubio noemt deepfakes een nationale veiligheidsbedreiging en leden van het Congres hebben Daniel Coats, de directeur van National Intelligence, een brief gestuurd waarin hij wordt gevraagd deze nieuwe bedreiging te bestrijden. Senator Ben Sasse introduceerde zelfs een wetsvoorstel waarin makers van deepfakes die de regering kunnen ondermijnen of aanzetten tot geweld tien jaar gevangenisstraf kunnen krijgen. Bovendien kunnen social mediaplatforms worden gestraft voor het (bewust) verspreiden van deepfakes.

Maar met het introduceren van een nieuw wetsvoorstel ben je er natuurlijk nog lang niet. Het aanpakken van het deepfakes-probleem is veel ingewikkelder. Social mediabedrijven zouden mogelijk zelfs authentieke content kunnen gaan verwijderen uit angst voor straffen. Bovendien zouden strikte wetten onschuldige parodievideo’s kunnen criminaliseren en de vrijheid van meningsuiting kunnen inperken. Daarbij bevinden veel potentiële aanvallers die deepfakes creëren zich buiten de VS en laten zich niet afschrikken door strenge sancties. Ondanks deze problemen verwachten autoriteiten in zowel de EU als de VS dat Facebook en andere social mediagiganten hun strijd tegen nepnieuws en vervalsingen zullen aanscherpen. Mariya Gabriel, de Europese commissaris voor digitale economie en samenleving, zegt “de tijd van mooie woorden is voorbij. Internetbedrijven moeten meer doen om nepnieuws en propagandacampagnes te bestrijden.

Techbedrijven vechten terug

Er zijn dus geen eenvoudige oplossingen en de verwachting is dat de uitdagingen rond deepfakes met incrementele stappen aangepakt zullen worden. Een goed begin is mensen waarschuwen voor onbetrouwbare sites, zoals de Edge-browser van Microsoft doet. Meer onderzoek naar deepfakes en het ontwikkelen van nieuwe bestrijdingstools zou een goede volgende stap kunnen zijn. Vijay Thaware en Niranjan Agnihotri, onderzoekers van cybersecuritybedrijf Symantec, hebben bijvoorbeeld software ontwikkeld om deepfakes mee te spotten door kunstmatige intelligentie aan de hand van 26 deepfakes te trainen. Hierbij wordt gelet op het feit dat de personen in nepvideo’s niet vaak genoeg met hun ogen knipperen. Volgens de onderzoekers is de software veelbelovend, alhoewel het precieze succespercentage nog niet bekend is. Ze merken op dat het alleen werkt bij video’s die langer zijn dan een minuut en die niet volledig kunstmatig gegenereerd of te geavanceerd zijn.

Technische adviseurs als Akash Takyar stellen voor om een nieuwsplatform te ontwikkelen op basis van blockchaintechnologie. Nieuwsbronnen kunnen bijvoorbeeld geverifieerd worden door elk artikel of elke video van een unieke QR-code te voorzien. The Decentralized News Network doet al iets soortgelijks, maar dit op tokens gebaseerde, betaalde model laat wel nog het een en ander te wensen over. In dit tijdperk van gratis nieuws slagen namelijk alleen de meest bekende mediabedrijven erin om hun lezers te laten betalen voor hun content.

De blockchain-startup Truepic pakt deepfakes op een andere manier aan. Het bedrijf heeft een smartphonecamera-app ontwikkeld die de integriteit van een afbeelding verifieert door bijvoorbeeld te controleren of de coördinaten en tijdzone van de camera overeenkomen met die van de omringende wifi-netwerken. De app bevestigt dus dat de tijds- en locatiegegevens van een foto correct zijn. Daarna wordt de afbeelding of video opgeslagen op een blockchain-netwerk. Zodra zo’n foto of video dan viraal gaat, kan men de content met het origineel vergelijken. Truepic is van plan om met smartphoneproducenten samen te werken om deze technologie een industriestandaard te maken. Zo zouden alleen afbeeldingen die overeenkomen met die in de blockchain-database in de toekomst op social media bijvoorbeeld een vinkje kunnen krijgen, zodat je weet dat ze authentiek zijn.

Hoe ver is ver genoeg?

Dankzij in het verleden nog onweerlegbaar foto- en videobewijs geloofden we dat er in 1969 astronauten op de maan stonden en dat een demonstrant op het Plein van de Hemelse Vrede in China een colonne tanks probeerde tegen te houden. Maar als gevolg van technologische ontwikkelingen als KI-deepfakes kunnen we niet langer blindelings op audio en video vertrouwen. Het bestrijden van deze dreiging is een complexe aangelegenheid die alleen kan slagen als techbedrijven, regeringen en burgers met elkaar samenwerken.

Kunnen we deepfakes met kunstmatige intelligentie of blockchain bestrijden? Zijn private bedrijven beter in staat om de uitdaging aan te gaan dan openbare instellingen zoals het Pentagon? Er zijn geen eenvoudige antwoorden op deze vragen, maar één ding is zeker: de toekomst ziet er wat nepcontent betreft niet bepaald rooskleurig uit. De nieuwste ontwikkelingen laten zien dat er in video’s straks niet langer alleen met gezichten geknoeid wordt, maar ook met lichamen. We weten allemaal dat we met technologie veel goeds kunnen doen, maar het wordt ook steeds vaker voor sinistere doeleinden gebruikt. Het lijkt er soms op dat de mensheid moedwillig zijn eigen ondergang tegemoet gaat…

Share via: