- Onze bezorgdheid over de veiligheid van zelfrijdende auto’s is niet onterecht

- Hebben we door het ongeval met de Uber echt meer redenen om bezorgd te zijn?

- Terug naar de basis – voorkomen is beter dan genezen

Zelfrijdende systemen beloven een toekomst zonder verkeerschaos en -ongevallen. Ze behoren duidelijk tot de meest verstorende technologieën van het moment. Al eerder schreven we over de enorme vooruitgang in de ontwikkeling van de systemen die geautomatiseerd rijden mogelijk maken, en zien een positieve toekomst van autonoom rijden tegemoet. Maar we moeten ook eerlijk toegeven dat deze technologie – die nog in de kinderschoenen staat – nog heel wat kilometers te gaan heeft voordat we er echt veilig de weg mee op kunnen. Daar komt nog eens bij dat de maatschappij en de huidige infrastructuur onvoldoende voorbereid zijn op de komst van de intelligente superauto.

Sterker nog, de meeste consumenten zijn huiverig voor geautomatiseerd rijden. Ze zijn gewoon nog niet bereid om de technologie te vertrouwen. Als we ervoor zouden kiezen om ons door zelfrijdende auto’s te laten vervoeren, zou dat betekenen dat we ons volledig moeten overgeven. Dan hebben we het stuur niet langer in handen en heeft de slimme auto het voor het zeggen. En dat idee geeft veel mensen een onbehaaglijk gevoel.

Begrijpelijk, maar wat we niet moeten vergeten is dat in 2016 – alleen al in de VS -meer dan 37,000 mensen zijn omgekomen bij verkeersongevallen. Verreweg de meeste van deze ongevallen waren het gevolg van menselijke fouten. Deskundigen die de toekomst van zelfrijdende systemen zorgvuldig onder de loep hebben genomen, denken dat ons hier niet langer zorgen over hoeven te maken zodra de machines eenmaal aan het roer staan. Als zelfrijdende systemen eenmaal op de weg zijn kunnen ze volgens de RAND Corporation tienduizenden levens per jaar redden. Dat zijn geen kleine aantallen en het is dan ook te begrijpen waarom er zoveel buzz rond deze technologie is. Maar recente ongevallen met zelfrijdende auto’s roepen aan de andere kant ook weer vragen op.

Onze bezorgdheid over de veiligheid van zelfrijdende auto’s is niet onterecht

Met Google’s Waymo – en later met Tesla en Uber – raakte de ontwikkeling van zelfrijdende systemen in een stroomversnelling. Google begon in 2009 te werken aan hun autonome auto, waarvan de eerste modellen binnen een paar jaar al in totaal 300.000 mijl hadden afgelegd. Eind vorig jaar kondigde Google aan dat hun wagenpark al bijna 6,5 miljoen autonoom gereden kilometers op de teller had staan. Naast Google heeft ook Uber zijn systemen in de echte wereld getest. Onlangs stond er voor deze ride-sharing gigant maar liefst een gecombineerde 3,2 miljoen kilometer op de klok.

Dat is best wel indrukwekkend, maar om de veiligheid van autonome auto’s nauwkeurig in te schatten, hebben we veel meer kilometers nodig. Zo reden Amerikanen in 2016 bijna 5,2 biljoen kilometer, wat leidde tot 1,18 dodelijke verkeersongevallen per 161 miljoen gereden kilometers. Die vermijdbare sterfgevallen lopen zo al snel op – een van de redenen waarom we een veiliger alternatief willen. Maar om te beoordelen hoe veilig zelfrijdende auto’s zijn, moeten ze aanzienlijk meer kilometers gaan maken, anders is het geen appels met appels vergelijken.

De vroege pilots met geautomatiseerde veiligheidssystemen zijn vrij positief, maar na een ongeval met een elektrische sedan van Tesla Model S – waarbij de bestuurder om het leven kwam, kreeg de publieke perceptie van zelfrijdende auto’s een behoorlijke knauw. De Tesla reed zonder te remmen in op vrachtwagen die de weg overstak. In de verklaring van de National Highway Traffic Safety Administration (NHTSA) is te lezen dat de auto de remmen niet had geactiveerd, omdat hij een ander voertuig niet ‘zag’.

Dat is niet bepaald geruststellend. Bovendien zeggen officials dat de ”autopilot van Tesla gebruikt kon worden op wegen waarvoor het systeem niet was ontworpen, en dat een handen-op-het-stuur detectiesysteem een slecht substituut is voor het meten van de alertheid van de bestuurder”. In dit geval vertrouwde de bestuurder teveel op de technologie, aldus de Amerikaanse Onderzoeksraad. Bovendien heeft men aangetoond dat de bij het ongeval betrokken vrachtwagenchauffeur “onvoldoende veiligheidsmarge had gegeven voordat hij zijn bocht begon te maken”. Uiteindelijk is gebleken dat er verschillende oorzaken waren voor het ongeval, waaronder verkeerd gebruik van de technologie, slechte alertheid van de Teslabestuurder en onvoldoende signalering door de vrachtwagenchauffeur.

Was dit ongeluk nu de fout van het zelfrijdende systeem of de menselijke bestuurder? Niet helemaal – of helemaal niet – duidelijk, als je het ons vraagt.

Hebben we door het ongeval met de Uber echt meer redenen om bezorgd te zijn?

Maar het laatste ongeluk met de Uber, dat leidde tot de dood van een voetganger, zou ertoe kunnen leiden dat er met betrekking tot zelfrijdende auto’s nu heel hard op de pauzeknop gedrukt wordt. Dat we de veiligheid opnieuw onder de loep moeten nemen staat buiten kijf, maar een zorgvuldige analyse van deze tragedie brengt – weer – geen duidelijk probleem aan het licht.

Het ongeluk gebeurde zondagavond laat in Tempe (Arizona). De Uber-auto reed in de automatische piloot, maar er zat ook iemand achter het stuur. De auto reed 38 mijl per uur in een zone waar je 45 mag. Vervolgens reed de Uber een overstekende voetganger dood. Bloomberg Technology schrijft : “Elaine Herzberg, 49 jaar, liep naast een voetgangersoversteekplaats toen ze door de Uber-auto werd geraakt”. Sylvia Moir, hoofd van de politie van Tempe, zegt dat – op basis van de feiten dat het donker was en dat de voetganger de weg niet op de aangewezen plek overstak – het ongeval moeilijk te voorkomen was, ongeacht wie (of wat) er op dat moment reed.

Volgens de wetgeving van Arizona moeten “voetgangers die niet op de aangewezen oversteekplaatsen oversteken aan voertuigen voorrang verlenen”. Juridisch gezien is het voertuig misschien niet in gebreke – maar dat is ook niet het discussiepunt. Ook als voetgangers of andere weggebruikers fouten maken, moeten zelfrijdende voertuigen ongevallen kunnen voorkomen. Zowel het zelfrijdende systeem als de bestuurder van deze auto hebben het ongeluk niet kunnen voorkomen. Gaat het hier nu eigenlijk wel of niet om een storing in de geautomatiseerde veiligheidssystemen van Uber?

Anthony Foxx, voormalig minister van Transport onder president Barack Obama, beschrijft het ongeval als een “waarschuwing voor de hele sector en de overheid om veiligheid de hoogste prioriteit te geven”. En hij is niet de enige die oproept tot strengere regels. John M. Simpson, Privacy & Technology Project Director van Consumer Watchdog, merkt op: “De robotauto’s zijn niet in staat om menselijk gedrag nauwkeurig te voorspellen en het echte probleem ligt in de interactie tussen mensen en de robotvoertuigen”. Daar heeft hij duidelijk gelijk in.

Terug naar de basis – voorkomen is beter dan genezen

Uit MIT Technology Review blijkt dat zowel de NHTSA als de National Transportation Safety Board (NTSB) “onderzoeken hebben gestart naar wat er is gebeurd” en wat er in de toekomst kan worden gedaan. Subbarao Kambhampati, een professor aan de Universiteit van Arizona State University, gespecialiseerd in kunstmatige intelligentie, merkt op dat het Uber-ongeluk vragen oproept. In hoeverre kunnen de veiligheidsbestuurders de systemen bijvoorbeeld echt effectief controleren? Dat is een goede vraag, zeker als je menselijke factoren als onoplettendheid en vermoeidheid meerekent.

Natuurlijk kampen alle automobilisten met dergelijke problemen en een van de manieren om ongevallen te voorkomen is door ons te helpen beter te rijden. Bryan Reimer, een onderzoekswetenschapper aan het MIT, toont aan dat er veel kan worden bereikt “met een systeem dat de mentale belasting en oplettendheid van een bestuurder kan inschatten met sensoren op het dashboard die hartslag, huidgeleiding en oogbewegingen meten”. Hiermee kun je “een soort adaptieve automatisering” bieden, waarbij het voertuig “in meerdere of mindere mate gebruik maakt van zijn autonome functionaliteit, afhankelijk van hoe geconcentreerd en oplettend de bestuurder is”. Hoewel dit een veelbelovende benadering en aanpak is, hebben we hiermee nog steeds geen antwoorden op fundamentele vragen over de veiligheid van zelfrijdende systemen.

Tesla is inmiddels bezig met het verbeteren van hun zelfrijdende technologie: “De opkomende autonome coast-to-coast testrit zal een belangrijke sprong voorwaarts zijn voor onze zelfrijdende technologie”, zeiden ze. “Bovendien hebben we onlangs een uitgebreide revisie van de onderliggende architectuur van onze software voltooid, waardoor het verzamelen en analyseren van gegevens stapsgewijs is verbeterd en de mogelijkheden op het gebied van machine learning fundamenteel zijn verbeterd”.

De hoop is dat de nieuwe versie van de autopilot beter zal presteren dan de voorgaande, waardoor het systeem soepeler en veiliger zal werken.

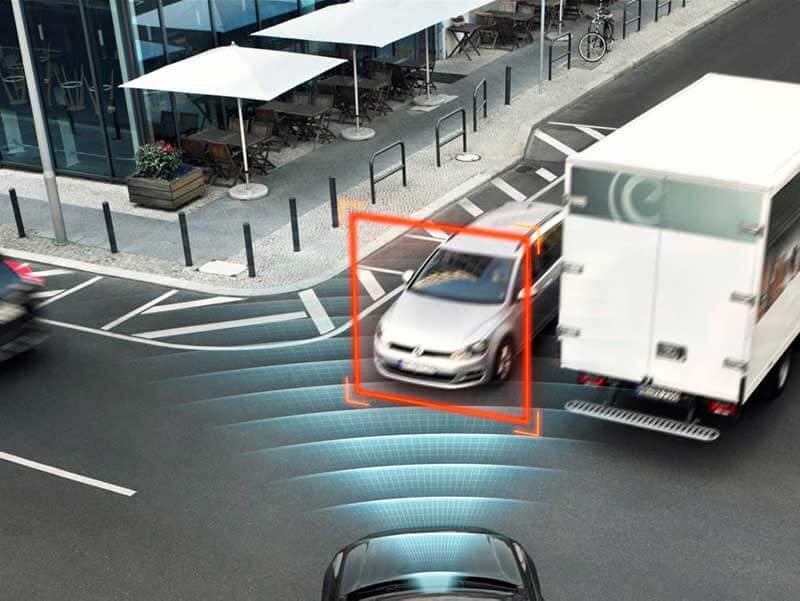

Hier kun je zien hoe het in z’n werk gaat:

We kunnen niet met zekerheid zeggen of de dodelijke ongelukken de schuld waren van de technologie. In beide gevallen hadden menselijke bestuurders uiteindelijk de controle en de verantwoordelijkheid en in beide gevallen konden ook zij het ongeval niet voorkomen. Natuurlijk verandert dat niets aan het afschuwelijke noodlot en het verdriet voor de nabestaanden. Het is duidelijk dat de industrie en de regelgevende instanties een stap terug moeten doen en de basisveiligheid opnieuw onder de loep moeten nemen.

Share via: